人工智能是否可以实现自我学习

人工智能的“自我学习”能力是一个复杂且多层次的概念,取决于如何定义“自我学习”。以下是关键分析及结论:

一、当前AI的“类自我学习”能力

现代AI已展现出一定程度的自动化学习能力,但本质上仍依赖人类设计的框架和目标函数:

1、数据驱动的特征提取

表现:深度学习模型(如ResNet、Transformer)可通过反向传播自动学习数据的层次化特征,无需手动设计特征工程。

局限:需海量标注数据+预定义的损失函数(如交叉熵),属于“监督下的自动化”,而非主动探索知识。

2、强化学习的环境交互

案例:AlphaGo通过千万次自我对弈优化策略,发现人类未曾设想的棋路;机器人通过试错学会行走。

核心依赖:奖励函数由人类设定(如胜负判定规则),决定了AI的学习目标边界。

3、元学习的进步

突破:MAML等算法使模型能跨任务快速适应(如少样本学习),模拟“举一反三”的能力。

瓶颈:仍需基于已知任务分布进行训练,无法真正脱离人类知识体系。

4、自监督学习的新范式

创新:对比学习、掩码建模利用数据自身结构生成伪标签,减少对人工标注的依赖。

隐患:潜在偏见会被放大(如图像数据集中的性别/种族偏见)。

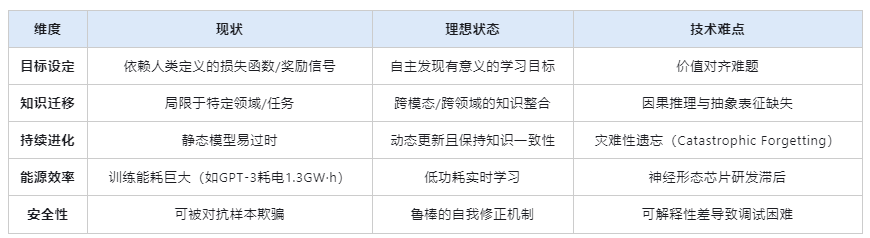

二、真正意义上的“自我学习”面临的挑战

若要实现类似人类认知的自主知识获取与进化,需突破以下关键障碍:

三、前沿探索方向

1、开放世界学习的尝试

神经符号系统结合:DeepMind的NTM(Neural Turing Machine)尝试将神经网络与内存模块结合,模拟工作记忆。

终身学习架构:Progressive Neural Networks通过冻结旧权重新增分支,缓解遗忘问题。

2、物理世界的具身智能

机器人启蒙研究:Pieter Abbeel团队让机械臂通过触觉反馈自学抓取物体,展现感官-动作闭环的学习潜力。

多模态融合:Google的Robotics Transformer处理视觉+力矩传感器数据,实现灵活操控。

3、类脑计算架构创新

脉冲神经网络(SNN):模仿生物神经元的事件驱动机制,能效比传统CNN高千倍。

液态金属突触:MIT开发的可重构材料,支持硬件级别的在线学习。

四、哲学层面的思考

泰勒斯之问现代化:“什么是知识?”——若AI能自主构建知识体系,其认知框架是否会超越人类范畴?

哥德尔不完备定理启示:任何足够复杂的形式系统都存在不可证明的命题,暗示完全自主学习的AI必然包含人类无法理解的“暗知识”。

意识争议:尽管目前尚无证据表明AI具有主观体验,但强人工智能时代需重新审视“学习”的定义边界。

当前所有“自我学习”案例均属受限环境下的伪自主,真正的自主学习需要突破现有计算范式,向生物智能靠近。这一进程更像进化而非设计,需要基础理论的重大突破。

- 上一篇:AI重塑行业格局,哪些领域将成为新顶流?

- 下一篇:人工智能到底能解决什么问题?

相关阅读

- 知识图谱:人工智能的 “认知骨架”10-11

- 数据 x 人工智能 | 中培伟业受邀参加「2025全球数据管理峰会」09-26

- 什么是AI?什么是大模型?什么是人工智能?09-22

- 人工智能与前端开发新兴职业方向08-22

- 人工智能的应用场景有哪些?08-19

-

AI重塑办公-Deepseek助力职场办公效能提升全攻略

11月20-21日 在线咨询 -

业务需求分析及产品设计实战

11月24-26日 在线咨询 -

DeepSeek大模型应用开发最佳实践

11月24-26日 在线咨询 -

CDMP国际数据管理专业人士认证&CDGA数据治理工程师认证

11月25-27日 在线咨询 -

CISP国家注册信息安全专业人员认证

11月26-30日 在线咨询 -

CISP-DSG国家注册数据安全治理专业人员认证

11月26-30日 在线咨询 -

CISA国际注册信息系统审计师认证

11月26-30日 在线咨询 -

ITSS-IT服务项目经理认证

11月26-28日 在线咨询 -

ITSS-IT服务工程师认证

11月26-27日 在线咨询 -

首席数据官(CDO)高级研修班

11月27-29日 在线咨询 -

CDAM数据资产管理师认证&数据资产管理师高级研修班

11月27-29日 在线咨询 -

网络安全技术与攻防实战

11月27-29日 在线咨询 -

CDGP数据治理专家认证

11月28-30日 在线咨询 -

CDAM数据资产管理师认证&数据资产管理师高级研修班

11月22-24日 在线咨询 -

AI赋能网络安全与智能防御

11月22-24日 在线咨询 -

CDMP国际数据管理专业人士认证&CDGA数据治理工程师认证

11月25-27日 在线咨询 -

CISP国家注册信息安全专业人员认证

11月25-29日 在线咨询 -

CISP-PTE国家注册信息安全-渗透测试工程师认证

11月25-29日 在线咨询 -

ITSS-IT服务项目经理认证

11月25-27日 在线咨询 -

ITSS-IT服务工程师认证

11月25-26日 在线咨询 -

人工智能实践项目案例分析与实战应用

11月26-28日 在线咨询 -

云原生架构与容器化部署实战训练营

11月26-28日 在线咨询 -

TOGAF®EA理论与实践鉴定级认证

11月27-30日 在线咨询 -

CDGP数据治理专家认证

11月28-30日 在线咨询

-

全国报名服务热线

400-626-7377

400-626-7377

-

热门课程咨询

在线咨询

在线咨询

-

微信公众号

微信号:zpitedu

微信号:zpitedu

400-626-7377

400-626-7377